Jacques Baudron – Juin 2023

L’intelligence artificielle intrigue mais effraie également : atteindra-t-elle un jour les capacités du cerveau humain ?

Impressionné par ChatGPT, le futurologue de Google Ray Kurzweil n’a aucun doute : c’est pour dans dix ans. La réponse proposée dans ce papier en doute, la mécanique utilisée par l’intelligence artificielle et celle de l’intelligence naturelle étant de nature totalement différente.

La mécanique de l’intelligence artificielle

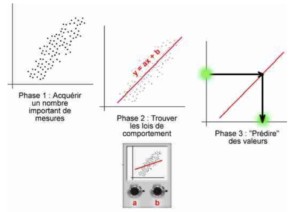

L’intelligence artificielle tire sa force de l’exploitation statistique de données. En utilisant un maximum de données enregistrées, des calculs que l’on peut rapprocher de la régression linéaire permettent de proposer la séquence de données suivantes les plus probables.

Exemple : en rapprochant pointure et taille sur de nombreux échantillons on obtient un nuage de points. Le jeu est maintenant de déterminer la droite qui colle au mieux à ce nuage. La pente et la hauteur indiqueront une pointure probable en fonction de la taille.

Neurone artificiel

Des centaines voire milliers de modules électroniques munis de ces deux réglages forment un réseau que l’on n’hésite pas à qualifier de « réseau de neurones » ; les différents ajustements de pentes et hauteurs de chacun de ces modules se font par apprentissage en soumettant le réseau à d’importants jeux de données. La simplicité énoncée du principe ne doit pas masquer les avancées mathématiques et technologiques qu’elle recouvre.

La technique impressionne par ses résultats. Les machines sont capables de reconnaître des formes constituées de suites de lignes. Un objet est identifié quand après un long apprentissage, une suite de vecteurs peut rejoindre une classe d’objets similaires. L’association de cette classe à une chaîne de caractères ASCII donne le verdict : nous sommes « probablement » face à une voiture, une tumeur ou un moustique.

Bien entendu la voiture ne sera pas identifiée comme un objet dans lequel on monte pour se déplacer. La notion de concept n’existe pas en intelligence artificielle.

Innovation

Par construction, l’innovation n’est pas de mise. On ne sait que poursuivre une tendance. Il y a quelques années le doute est venu quand une intelligence artificielle a surpris les plus grands joueurs au jeu de GO avec une stratégie inédite.

Mais c’est le fruit de « l’algorithme de Monte-Carlo » qui consiste dans une situation donnée, à tester au hasard certaines positions sur des milliers de parties. On est ainsi capable de noter les différentes cases du jeu en fonction de la probabilité de remporter une partie. La technique s’apparente à la recherche de mot de passe par force brute, ce n’est pas de l’innovation.

ChatGPT

L’affolant ChatGPT est dans cette même lignée qui consiste à piocher dans l’existant pour extrapoler la suite. On picore dans une gigantesque base de données de phrases pour trouver LE mot qui statistiquement pourrait compléter une phrase, mais sans la moindre notion du concept porté par ce mot.

Les « maîtres » de l’intelligence artificielle n’ont pas été surpris (« Ce sont des recettes que l’on connaît depuis plusieurs années qui ont été mises ensemble » précise Yann Le Cun) mais ses performances vont au-delà de ce qu’on pouvait imaginer. Les phrases sont bien construites, la forme est irréprochable, seule la compréhension de la signification du discours manque.

Au-delà d’une forme lisse et respectueuse des règles grammaticales, tous les dialogues cohabitent. Les non-sens peuvent être savoureux, j’ai en tête un échange totalement décousu sur le nombre et la place des « n » dans « mayonnaise ». ChatGPT a entre autres errements affirmé qu’il n’y avait qu’un seul « n » situé entre le « a » et le « o ». Les journalistes peuvent-ils réellement redouter un concurrent qui valide une information avec comme seul critère d’être souvent rencontrée ?

Nul besoin de comprendre de quoi l’on parle, nulle obligation de saisir des concepts : l’extrapolation depuis les données récupérées suffit à en donner l’illusion.

La « mécanique » de l’intelligence naturelle

Savez-vous comment fonctionne l’intelligence naturelle ?

Non ? Ce n’est pas étonnant, personne ne le sait.

Mystères de l’intelligence naturelle

On observe des flux électriques entre différentes zones du cerveau, mais on ne sait toujours pas localiser les souvenirs. On soupçonne les intestins d’être dans le circuit. À l’inverse de la mémoire informatique, les souvenirs humains évoluent à chaque fois qu’ils sont sollicités et peuvent même être effacés.

Avec trois cents neurones, le Caenorhabditis Elegans, ver transparent de quelques millimètres a déjà de la conscience. Alors se réfugier derrière la centaine de milliards de neurones du cerveau humain pour arguer que l’on ne dispose pas encore de la puissance de calcul nécessaire ne semble pas crédible. Les réseaux de trois cents neurones artificiels sont courants de nos jours, on n’a pas pour autant atteint le niveau d’intelligence du Caenorhabditis Elegans.

Pire, le Physarum polycephalum dont sont friands les enseignants du primaire sous le nom de blob est un être vivant, fuyant la lumière alors qu’il est unicellulaire. Autrement dit, pas le moindre neurone chez lui. Extrapoler le nombre de « neurones » électroniques d’une intelligence artificielle pour deviner quand on en aura autant qu’une intelligence humaine a-t-il un sens ?

Émotions

Citons également le rôle majeur des émotions dans les prises de décision. Herbert Simon ainsi que Daniel Khaneman, sont des psychologues récompensés par des prix Nobel d’économie pour leurs travaux sur la prise de décision. L’un comme l’autre ont bousculé la conviction de la prise de décision rationnelle chère à Von Neuman dans la théorie des jeux. La démarche est de fait instinctive et largement dictée à l’émotion.

Damasio a montré qu’un dommage sur les régions du cerveau liées aux processus émotionnels altère les capacités de prises de décision.

Conscience

La question de la conscience est posée depuis bien longtemps, faut-il comme le pense Roger Penrose se tourner vers des superpositions quantiques à grande échelle ? Ou comme Descartes la chercher dans la glande pinéale, comme Freud dans la couche externe du cerveau, comme Sperry dans la globalité du cerveau ?

Apprentissage « artificiel » vs apprentissage « naturel » : l’écueil du concept

À défaut de pouvoir faire une comparaison point par point sur les mécaniques des intelligences artificielle et naturelle penchons-nous sur les mécanismes d’apprentissage.

Il faut des milliers d’exemples d’un objet (voiture, tumeur, personne) pour qu’une intelligence artificielle puisse en reconnaître une, alors que la démarche chez l’humain (et plus généralement chez l’animal) est de s’appuyer sur des concepts. Ainsi une voiture fût-elle un cabriolet, un break, un jouet ou une citadine est perçue comme telle en tant que concept par un enfant après un apprentissage succinct.

Comment peut-on être aussi affirmatif ? Des expériences ont permis de mettre en évidence la possibilité pour un nourrisson de manipuler des concepts. Je n’évoquerai que celles qui porte sur le concept abstrait de nombres. J’ai pour ma part été impressionné par les résultats.

Les expériences se font sur des enfants de quelques mois. L’apprentissage intensif à l’image de l’intelligence artificielle est donc écarté.

Le concept de nombre

On fait entendre un bruit (sifflement, voix, ou choc) à plusieurs reprises puis on présente sur un écran des groupes de plusieurs objets. La mesure consiste à observer le temps passé par le regard sur chacun des groupes pour détecter des corrélations avec le signal sonore.

Les conclusions sont qu’effectivement un concept aussi abstrait que celui d’un nombre est déjà là (probablement du domaine de l’inné ?).

On peut même aller plus loin avec des opérations. On place des objets un par un derrière un écran, puis on les retire toujours un par un. En observant le regard du nourrisson on peut voir s’il attend ou non un autre objet. Le vice a même été poussé jusqu’à retirer un objet de plus que ce qui avait été mis ce qui a suscité une réaction de surprise à des résultats impossibles (1+1 = 3 par exemple). L’enfant sait faire une soustraction. Curieusement il semblerait que ces facultés observées sur les nourrissons s’estompent avec l’acquisition du langage.

Ce type d’expériences a également été réalisé sur des animaux.

Je ne peux que vous inciter à vous pencher sur les passionnants travaux de la psychologue Karen WYNN sur ceux du neuropsychologue Stéphane DEHAENE ou du neurologue Antonio DAMASIO pour ne citer qu’eux. Leurs résultats plaident pour l’inné vont à l’encontre des thèses de l’acquis que défendaient Sigmund FREUD ou Jean PIAGET.

Expériences de pensée

Galilée a poussé dans ses retranchements l’affirmation suivant laquelle une grosse pierre tombe plus vite qu’une petite en posant simplement la question de savoir ce qui se passe quand on fait tomber une grosse pierre attachée à une plus petite. En raccourci, sa conclusion est que dans le vide les deux tombent à la même vitesse. Performance d’autant plus remarquable qu’à l’époque la notion de vide n’existait pas réellement.

Quant à Einstein, il est parti de deux constatations : tous les corps tombent à la même vitesse, établie par Galilée et la vitesse de la lumière est finie, établie par Ole Rømer en 1676. Il a en outre postulé l’équivalence entre accélération et gravité. La conclusion lui est alors apparue : la lumière est déviée par la gravité. Cette brique de la relativité générale lui est apparue alors qu’il savourait entre pipe et café un début d’après midi à son bureau de Berne. Ce fut, à ses dires « l’idée la plus heureuse de sa vie ».

Pour ma part, je suis d’autant plus impressionné que Newton aurait déjà pu faire ce raisonnement car ces éléments lui étaient déjà connus.

Les expériences de pensée sont propres à l’intelligence humaine (voire animale ?). Elles n’utilisent que le raisonnement mené sur une poignée d’hypothèses. Nous sommes aux antipodes de l’apprentissage « chatbotien » de l’intelligence artificielle où la masse de données n’arrive pas à pallier le manque d’intuition.

L’intelligence artificielle ne sera pas mère d’une intelligence naturelle

Quelles conclusions porter sur ces considérations ?

Le point essentiel que j’ai cherché à porter dans ce papier est que ce n’est pas en augmentant la puissance de l’intelligence artificielle que l’on pourra se rapprocher de l’intelligence naturelle. La raison est mécanique : l’intelligence artificielle ignore toute notion de concept, ce qui la coupe de l’intuition et de l’émotion qui font partie des piliers de l’intelligence naturelle.

Un point de passage incontournable pour atteindre l’intelligence naturelle passe par sa compréhension. Il me semble que le discours commun de l’intelligence artificielle nous a abusé : baptiser « neurone artificiel » un simple comparateur à seuil ne permet pas d’atteindre les capacités d’un neurone naturel. Comment fonctionne un neurone ? Quelles sont les parts de l’inné et de l’acquis ?

Fixer comme le fait Ray Kurzweil l’échéance pour que l’intelligence artificielle rejoigne l’intelligence naturelle à dix ans me fait irrésistiblement penser à Ali Baba et les quarante voleurs : « quarante » signifie « beaucoup ». Il faut comprendre qu’on ne sait pas chiffrer le temps nécessaire car on ne sait toujours pas comment faire.

Références et bonnes lectures

– Autour de l’émotion :

L’ Erreur de Descartes, Par Antonio R. Damasio · 2006

… ainsi que ce podcast :

Le rôle de l’émotion dans la prise de décision :

https://www.cairn.info/revue-management-2009-2-page-118.htm

– Autour du cerveau :

Système 1 / Système 2 : Les deux vitesses de la pensée Daniel Kahneman 2011

– Le cours de Stéphane DEHAENE au Collège de France. (Dur, dur !)

– Les expériences de Karen WYNN sur l’addition et la soustraction chez le nourrisson

https://cpb-us-w2.wpmucdn.com/campuspress.yale.edu/dist/f/1145/files/2015/09/McCrinkWynnPsychScience2004-27as1ep.pdf

Laisser un commentaire